Was der EU AI Act von Unternehmen fordert

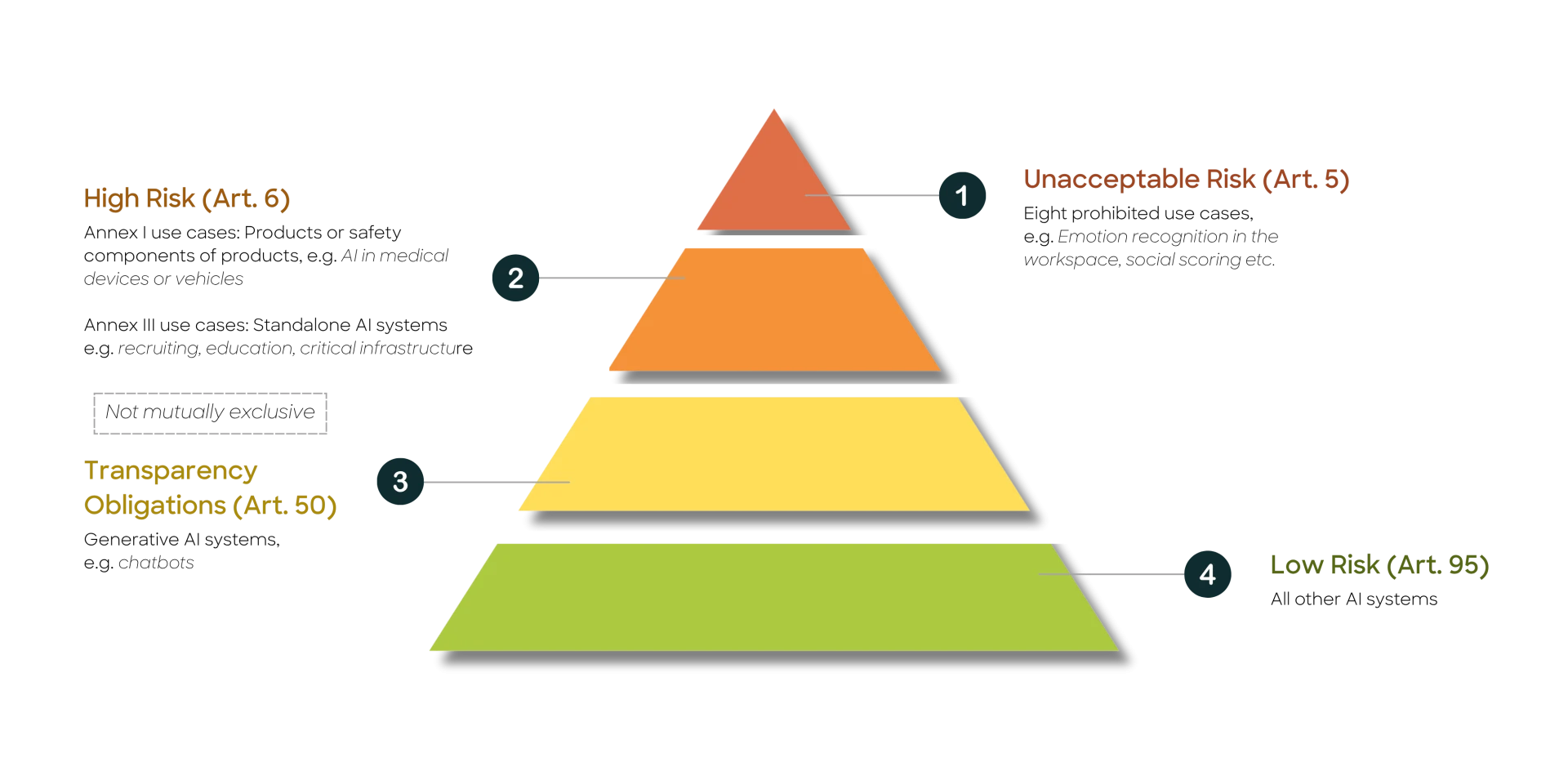

Der EU AI Act stuft KI-Anwendungen je nach Risiko ein – von gering bis hin zu verboten. Besonders dort, wo KI in sensiblen Bereichen wie Gesundheit, Personalwesen oder öffentlicher Verwaltung eingesetzt wird, gelten strenge Sicherheits- und Compliance-Vorgaben.

Die vier Risikoklassen des EU KI-Gesetzes – von verboten bis niedrigem Risiko.

Für Hochrisiko-KI-Systeme – etwa im Recruiting, bei der Kreditvergabe oder in der kritischen Infrastruktur – verlangt das Gesetz konkret:

- ein kontinuierliches Risikomanagementsystem (Art. 9)

- klare Anforderungen an Datenqualität und Daten-Governance (Art. 10)

- automatische Protokollierung von Ereignissen zur Rückverfolgbarkeit (Art. 12)

- Transparenz und Nutzungshinweise für nachgelagerte Akteure (Art. 13)

- wirksame Mechanismen zur menschlichen Aufsicht (Art. 14)

- Nachweise zu Genauigkeit, Robustheit und Cybersicherheit (Art. 15)

Viele Unternehmen stellen sich dabei dieselben praktischen Fragen: Wie setzen wir Artikel 9–15 auf Use-Case- und Organisationsebene um? Wie steuern wir den konformen Einsatz generativer KI? Welche Rollen und Prozesse sind für rechtliche und technische Anforderungen essenziell? Und wie integrieren wir Risikomanagement in unsere operativen Prozesse?

Risikoklassifizierung: Wo stehen Unternehmen wirklich?

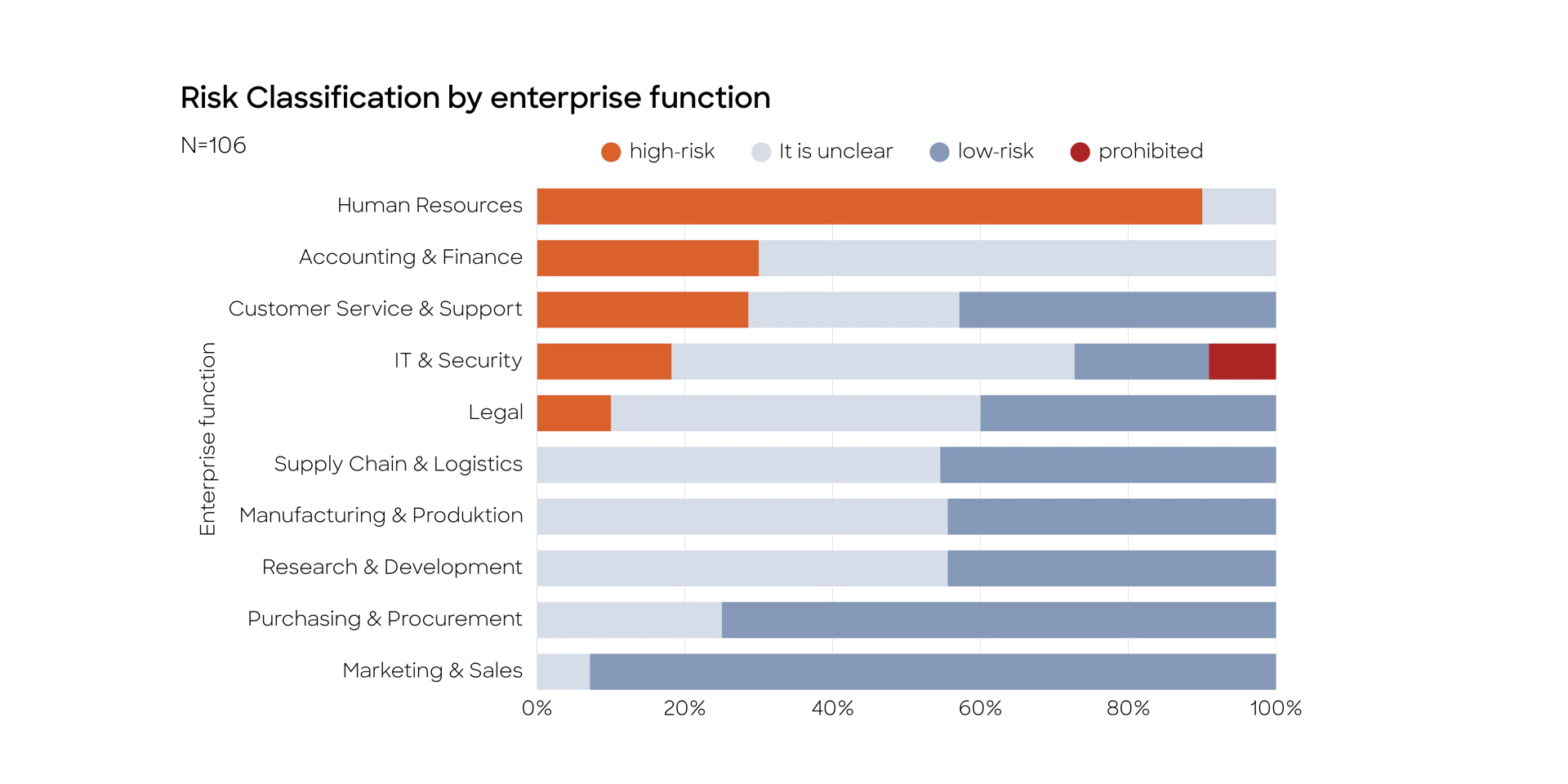

Eine der größten Herausforderungen in der Praxis ist die Risikoklassifizierung. appliedAI hat in einer Studie mehr als 100 KI-Systeme aus verschiedenen Unternehmensfunktionen analysiert – mit einem ernüchternden Ergebnis:

- 18 % der Systeme ließen sich klar als Hochrisiko einordnen

- 42 % fielen eindeutig in die Niedrigrisiko-Kategorie

- Bei 40 % blieb die Klassifizierung unklar

Risikoklassifizierung nach Unternehmensfunktion – im Bereich HR dominieren Hochrisiko-Systeme, im Marketing & Vertrieb sind die meisten Systeme niedrigrisikant.

Im ungünstigsten Fall könnten damit bis zu 58 % aller analysierten Systeme als hochriskant gelten. Besonders betroffen sind die Bereiche HR, Accounting & Finance, Customer Service und IT & Security.

Die Ursachen für diese Unsicherheit liegen oft in unklaren Definitionen im Gesetz selbst: Was gilt als „Aufgabe" im Sinne des AI Acts? Wann handelt ein System „im Auftrag einer Strafverfolgungsbehörde"? Wo genau liegt die Grenze bei kritischer Infrastruktur? Diese Fragen behindern Investitionsentscheidungen – und verlangsamen die KI-Adoption in Europa.

Was Unternehmen jetzt wissen müssen

Der AI Act gilt nicht nur für KI-Anbieter, sondern auch für Unternehmen, die KI-Systeme einsetzen. Die Pflichten variieren je nach Risikoklasse und Rolle – als Anbieter oder als Betreiber. Entscheidend ist daher: frühzeitig klassifizieren, Verantwortlichkeiten klären und Governance-Strukturen aufbauen, bevor die Fristen greifen.

Besonders für den Mittelstand gilt: Der AI Act muss kein Hindernis sein. Er bietet die Chance, KI-Prozesse systematisch zu verbessern, Vertrauen bei Kunden und Partnern aufzubauen und hochwertige KI-Anwendungen mit mehr Planungssicherheit zu skalieren.

Wie Unternehmen vom AI Act profitieren können

Richtig umgesetzt, bietet der AI Act echte strategische Vorteile:

- Interne KI-Prozesse und Risikobewusstsein nachhaltig stärken

- Vertrauen bei Kunden, Partnern und Aufsichtsbehörden aufbauen

- Hochwertige KI-Anwendungen gezielt skalieren

- Ethischen Technologieeinsatz als Differenzierungsmerkmal verankern

- Eine Grundlage für globale KI-Wettbewerbsfähigkeit schaffen

So unterstützt appliedAI bei der Umsetzung

appliedAI unterstützt Unternehmen in drei zentralen Bereichen:

AI Act Governance

Wir helfen dabei, die eigene KI-Risikolandschaft zu kartieren, Verantwortlichkeiten zu definieren und Governance-Prozesse skalierbar aufzusetzen – von Executive Briefings über die Entwicklung einer AI-Act-Roadmap bis hin zum Aufbau eines internen Risikomanagements, das auch Standards wie ISO 42001 berücksichtigt.

KI-Kompetenz

Artikel 4 des AI Acts verpflichtet Unternehmen dazu, die KI-Kompetenz ihrer Mitarbeitenden sicherzustellen. Unser KI-Kompetenz-Training Compact (45 Minuten, erfüllt Art. 4) sowie rollenspezifische EU AI Act Learner Paths für technische Fachkräfte, KI-Koordinatoren und KI-Anwender helfen dabei, diese Anforderung effizient und skalierbar zu erfüllen.

AI Act Engineering

Vertrauenswürdige KI muss von Anfang an compliant entwickelt werden. Wir begleiten Unternehmen beim Aufbau der technischen Infrastruktur – von Daten-Governance und automatisiertem Logging über menschliche Aufsichtsmechanismen bis hin zum „compliant-by-design"-Ansatz für KI-Anwendungsfälle. Von der Planung bis zur Produktion.

Sie möchten den AI Act in Ihrem Unternehmen sicher umsetzen?

Wir zeigen Ihnen, wie – und unterstützen Sie dort, wo Sie uns brauchen.