Seit dem 2. August 2025 sind die Bestimmungen des EU-KI-Gesetzes für allgemeine KI-Modelle (GPAI) offiziell in Kraft. Mit der Veröffentlichung der GPAI-Leitlinien hat die Europäische Kommission endlich Klarheit darüber geschaffen, wie diese neuen Vorschriften in der Praxis anzuwenden sind. Die Leitlinien helfen Entwicklern, Anwendern und anderen Akteuren entlang der gesamten KI-Wertschöpfungskette, ihre Verantwortlichkeiten zu verstehen und innerhalb des EU-Rechtsrahmens selbstbewusst innovativ zu sein.

Auf dieser Seite finden Sie:

- Eine kurze Zusammenfassung der wichtigsten Regeln, Definitionen und Verpflichtungen, die durch das KI-Gesetz eingeführt wurden,

- Unsere praktischen Tipps und Umsetzungsrichtlinien, die Ihnen helfen, diese Anforderungen effektiv und nachhaltig in Ihre internen KI-Governance-Prozesse zu integrieren.

Ganz gleich, ob Sie KI-Systeme entwickeln, integrieren oder prüfen – unser Ziel ist es, Ihnen dabei zu helfen, schneller und mit größerer Sicherheit von der Regulierung zur Umsetzung zu gelangen.

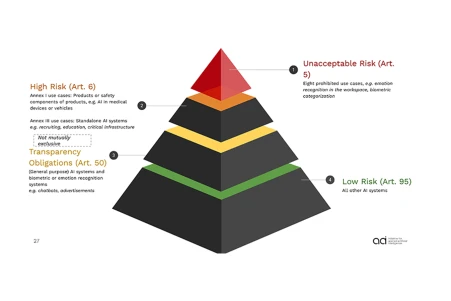

Der EU AI Act ist das erste umfassende Gesetz zur Regulierung von KI-Systemen. Er stuft Anwendungen je nach Risiko ein – von gering bis hoch – und legt verbindliche Anforderungen fest. Besonders dort, wo KI in sensiblen Bereichen wie Gesundheit, HR oder öffentlicher Verwaltung zum Einsatz kommt, gelten strenge Sicherheits- und Compliance-Vorgaben.

Doch wie lässt sich das in der Praxis umsetzen? Viele Unternehmen stehen vor genau dieser Frage:

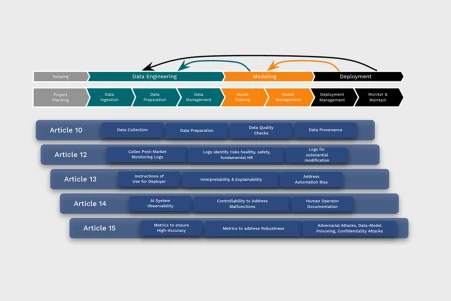

Wie setzen wir Artikel 9–15 auf Use-Case- und Organisationsebene um?

Wie steuern wir den konformen Einsatz generativer KI?

Welche Rollen und Prozesse sind für rechtliche und technische Anforderungen essenziell?

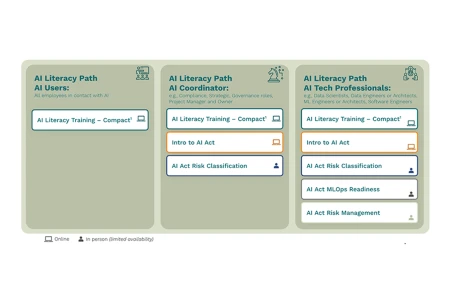

Wie befähigen wir unsere Mitarbeitenden gemäß den Anforderungen zur KI-Kompetenz?

Wie integrieren wir Risikomanagement in unsere operativen Prozesse?

appliedAI hilft Unternehmen dabei, Antworten zu finden – konkret, praxisnah und skalierbar. Damit Sie den AI Act nicht nur einhalten, sondern daraus echten Mehrwert ziehen.

Der EU AI Act ist mehr als ein Compliance-Thema. Richtig umgesetzt, bietet er Unternehmen die Möglichkeit:

Interne KI-Prozesse und Risikobewusstsein zu verbessern

Vertrauen bei Kunden, Partnern und Aufsichtsbehörden zu stärken

Hochwertige KI-Anwendungen gezielt zu skalieren

Ethischen Technologieeinsatz im Unternehmen zu verankern

Eine Grundlage für globale KI-Kompetenz zu schaffen

Für kleine und mittlere Unternehmen bietet der AI Act einen klaren Rahmen, um KI verantwortungsvoll einzusetzen – mit mehr Sicherheit und strategischer Orientierung.

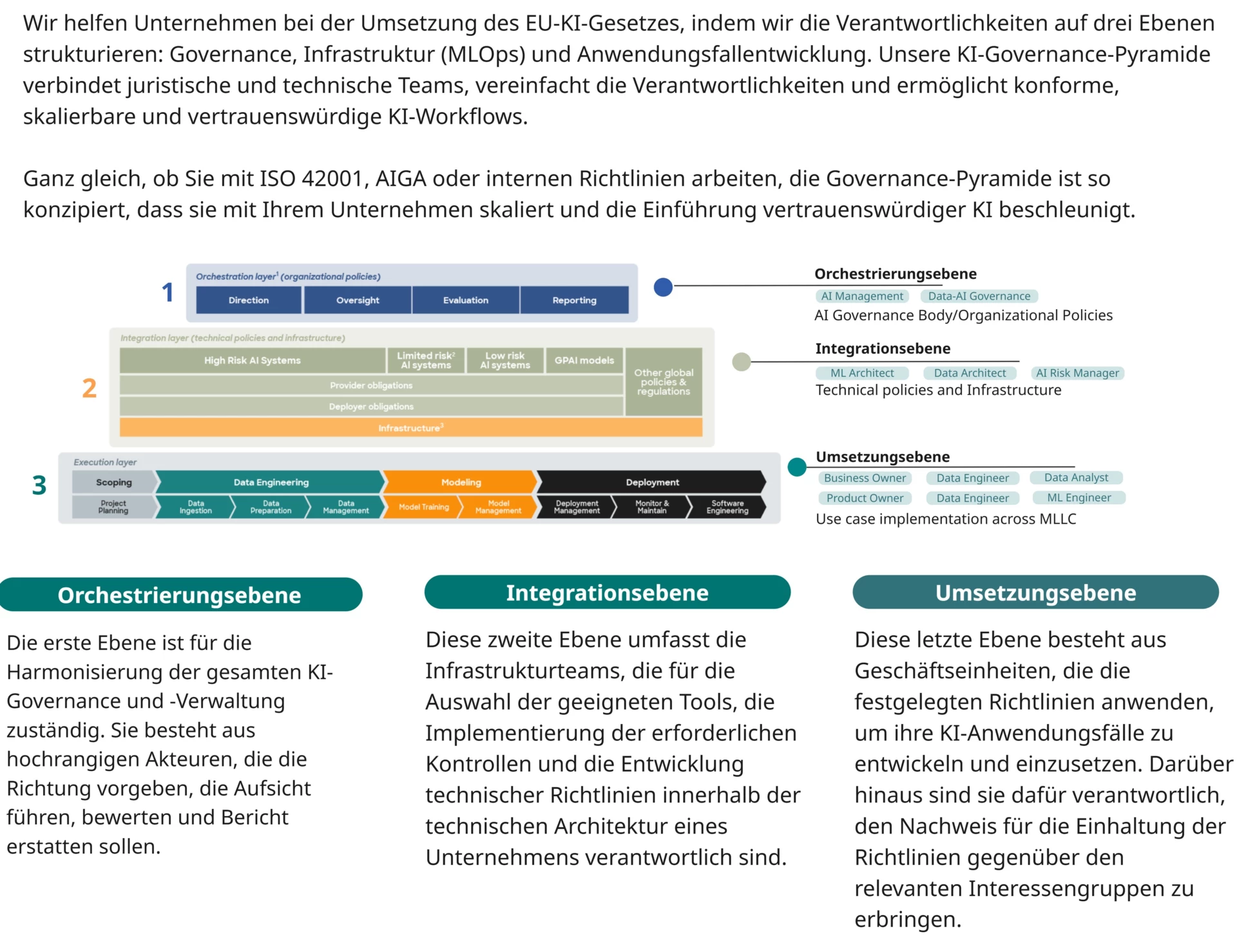

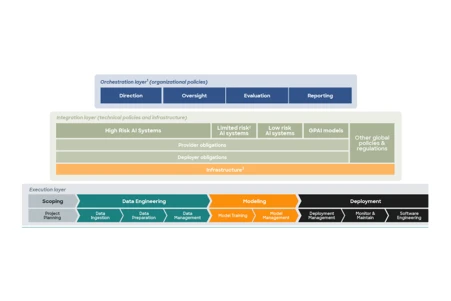

Wir unterstützen führende Unternehmen dabei, den AI Act mit klaren Strukturen, skalierbaren Prozessen und echtem Kompetenzaufbau wirksam umzusetzen:

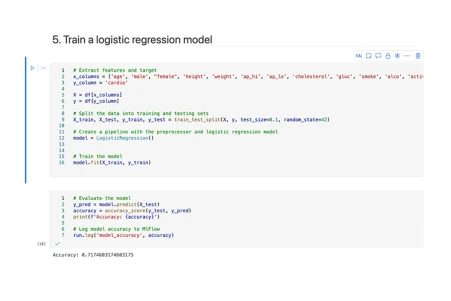

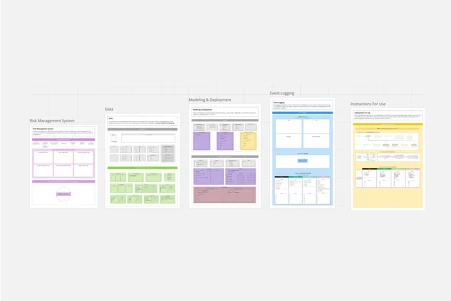

Risiken über verschiedene Anwendungsfälle hinweg systematisch erfassen und steuern

Verantwortlichkeiten und Governance-Strukturen gezielt etablieren

KI-Risikomanagement nachhaltig in der Organisation verankern

Audits bestehen und Standards wie ISO 42001 oder ISO 38507 erfüllen

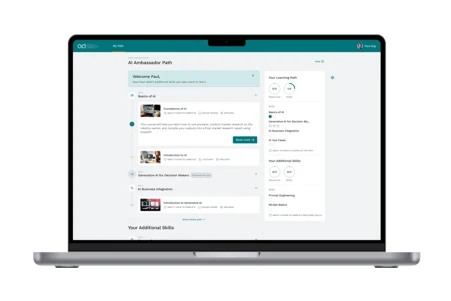

Interne Kompetenzen durch praxisnahe Trainings und langfristige Begleitung stärken

Dabei bringen wir nicht nur technisches Know-how mit, sondern auch eine europäische Perspektive – für rechtskonforme Umsetzung, Vertrauen bei Stakeholdern und Innovation mit Verantwortung.

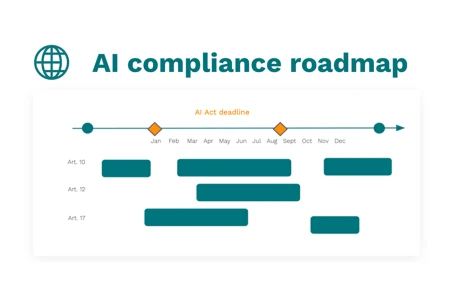

Aufbau einer skalierbaren AI Act Governance